AI-RAN Alliance는 무선접속망에 인공지능(AI)을 본격적으로 통합(2025.09.10)

요약: 아래 내용으로 볼 때, 무선 기지국에 AI칩이 사용될 수있으므로 AI칩이 데이터센터외에

다른 영역에서도 사용되기 때문에 엔비디아같은 칩 판매회사들에게 새로운 매출처가

생기는 것이다.

AI-RAN Alliance가 제시하는 “AI-on-RAN/AI-and-RAN” 모델이 확산되면,

도심·핵심 노드엔 GPU, 전국망 기지국엔 NPU/ASIC, 특수목적엔 FPGA라는

혼합형 생태계가 될 가능성이 큽니다.

-------------------------------------

AI-RAN Alliance(“에이아이-랜 얼라이언스”)는 **무선접속망(Radio Access Network, RAN)**에 인공지능(AI)을 본격적으로 통합하기 위해 전 세계 기술 기업, 학계, 통신 사업자 등이 협력하는 글로벌 컨소시엄입니다.

개요 및 역사

- 출범 시기: 공식적으로 2024년 2월에 설립되었습니다. (RCR Wireless News)

- 설립 배경: RAN을 단순한 통신 인프라에서 스스로 조직, 최적화, 자가 관리가 가능한 지능형 네트워크로 진화시키려는 목표로 시작되었으며, 단순 표준화보다 실제 적용에 중점을 둡니다. (RCR Wireless News)

핵심 미션

AI-RAN Alliance는 AI와 RAN이 상호작용하고 결합할 수 있는 생태계를 구축함으로써, 네트워크 운영 효율성 향상, 에너지 절감, 자동화 및 신사업 기회 창출을 도모합니다. 특히 5G와 6G 기반의 무선망 발전을 목표로 다양한 AI 활용 모델을 탐구합니다. (AI-RAN Alliance, RCR Wireless News)

주요 활동 분야: 3개의 워킹 그룹

- AI-for-RAN

RAN 성능 개선을 위한 AI 적용에 초점을 맞추며, 효율성, 용량 증대, KPI 달성 등을 향상시키려는 연구를 진행합니다. (RCR Wireless News) - AI-on-RAN

RAN의 인프라 위에서 AI 애플리케이션을 직접 실행할 수 있는 기반을 구축합니다. 지연(latency), 보안 등 문제를 해결하며 AI 수요 증가에 대응하는 것을 목표로 합니다. (RCR Wireless News) - AI-and-RAN

동일한 인프라에서 RAN 기능과 AI 작업을 동시에 처리하는 모델을 연구합니다. 인프라 활용도를 극대화하고, 새로운 AI 기반 수익 모델을 발굴하고자 합니다. (RCR Wireless News)

설립 주요 회원 및 현재 구성

- 설립 시점(2024년) 주요 회원으로는 SoftBank(의장 Alex Jinsung Choi), Arm, DeepSig, Ericsson, Microsoft, Nokia, Northeastern University, Nvidia, Samsung Electronics, T-Mobile US, University of Tokyo 등이 포함되었습니다. (Investopedia, RCR Wireless News, Computer Weekly)

- 2025년 7월 기준 100개 이상의 회원사가 가입했으며, Vodafone을 포함해 전 세계 17개국 이상의 기술 리더들, 학계, 통신사업자, 연구소, 산업 단체들이 참여하고 있습니다. (비즈니스와이어, Computer Weekly, TelecomTV)

- 최근 참가 사례:

- Cloudera는 ‘Data for AI-RAN’ 워킹 그룹에 참여하며, 데이터 오케스트레이션, LLM 기반 네트워크 자동화, MLOps 분야에서 역할을 수행합니다. (cloudera.com)

- Dell는 Open RAN 및 클라우드 RAN 경험을 바탕으로 테스트베드, 랩 및 벤치마킹 도구 제공 및 실용적인 AI-RAN 적용 실험을 주도합니다. (Dell)

- VIAVI는 AI-RAN Alliance 인증 실험실(lab)을 구축해 회원들이 AI-RAN 기술을 연구·시험할 수 있는 인프라 기반을 마련했습니다. (VIAVI Perspectives)

- Cloudera는 ‘Data for AI-RAN’ 워킹 그룹에 참여하며, 데이터 오케스트레이션, LLM 기반 네트워크 자동화, MLOps 분야에서 역할을 수행합니다. (cloudera.com)

최근 동향 및 영향력

- AI-RAN Alliance의 글로벌 확산: 설립 1년 이내에 100여 회원을 확보하며, 통신 인프라 혁신에 대한 국제적 관심과 협력의 상징이 되었습니다. (비즈니스와이어, Computer Weekly)

- 투자 전망: Dell’Oro Group의 예측에 따르면, 2029년에는 AI-RAN 관련 투자가 연간 100억 달러 이상에 이를 수 있으며, 이는 전체 RAN 장비 시장의 약 1/3에 해당합니다. 초기 투자 목적은 수익 창출보다는 네트워크 효율성 개선, 사용자 경험 향상, 전력 절감 등입니다. (TelecomTV)

- 연구 개발 동향:

요약 정리

AI-RAN Alliance는 RAN이 단순한 통신망을 넘어 AI 기반의 스스로 학습·최적화하는 지능형 인프라로 진화하는 과정을 가속화하는 핵심 플랫폼입니다. 통신 분야의 미래—특히 6G와 AI 융합 기반의 네트워크—를 선도하는 중요한 동력이라 할 수 있습니다.

더 궁금한 부분이 있으시면, 예를 들어 국내용 참여 기관, 특정 워킹 그룹의 최근 사례, 또는 관련 연구 논문 등에 대해서도 추가로 도와드릴 수 있어요.

Microsoft, Amazon, Nvidia, Arm, and Others Join Forces To Form AI-RAN Alliance

Microsoft, Amazon, Nvidia, Arm, Samsung, T-Mobile, Nokia, and others launched the AI-RAN Alliance, a group focused on revamping cellular technology for artificial intelligence.

www.investopedia.com

--------------------

질문: 그러면 무선 기지국에 AI칩이 장착되나요?

답변:

AI-RAN Alliance의 목표는 “AI가 무선 네트워크(RAN)에서 작동할 수 있는 구조”를 만드는 것이지, 반드시 모든 기지국에 AI칩을 넣겠다는 건 아닙니다. 하지만 실제 구현을 보면, 일부 기지국·DU(CU)/서버에 AI 가속기나 AI 연산 기능을 탑재하는 방향으로 가고 있습니다.

1. 현재 AI-RAN에서 말하는 AI 배치 방식

AI-RAN Alliance가 정의하는 워킹 그룹 3가지 중에서 특히 AI-on-RAN과 AI-and-RAN은 실제 무선 장비에 AI 연산을 붙이는 시나리오입니다.

- AI-for-RAN → 클라우드나 중앙 데이터센터에서 AI 모델을 돌려, RAN 파라미터 최적화(예: 빔포밍, 핸드오버) 결과를 내려보냄 → 기지국 자체에는 AI 칩 필요 없음

- AI-on-RAN → DU/CU 또는 베이스밴드 유닛에 AI 모델을 올려 inference 수행 → 기지국 서버급 장비에 GPU/ASIC/NPU 같은 AI 가속기 탑재

- AI-and-RAN → 같은 서버 하드웨어에서 RAN과 AI 워크로드를 함께 돌림 → 통합 서버(예: x86 + GPU/FPGA/NPU) 필요

즉, **엣지단(On-site DU, MEC 서버)**에 AI 연산 기능을 올려 지연(latency)을 줄이고, 네트워크를 실시간으로 최적화하는 구조를 목표로 하고 있습니다.

2. 실제 하드웨어 적용 예시

- Nvidia Aerial SDK + GPU → O-RAN 기반 vRAN에서 AI inference 실행 가능

- Intel FlexRAN + AI Acceleration Library → x86 서버 + VNNI/AMX 같은 AI 명령어로 RAN + AI를 같이 처리

- 삼성·에릭슨 → DU 장비에 AI inference 모듈 내장, 트래픽 예측·전력 최적화 수행

- Dell, HPE → Open RAN 서버 + GPU/NPU 옵션 제공, MEC 엣지에서 AI inference 가능

즉, “기지국 장비”라는 게 전통적인 베이스밴드 모듈(BBU) 박스가 아니라 x86 서버화(vRAN, OpenRAN) 되면서, AI 칩(GPU, NPU, FPGA)이 들어가는 사례가 늘어나는 중입니다.

3. 왜 꼭 AI칩이어야 하나?

- 실시간 최적화 필요 → 스케줄링, 빔포밍, 간섭 관리, 전력 절감 등은 ms 단위로 반응해야 하므로 로컬 inference가 유리

- 대역폭·비용 절감 → 클라우드에 데이터를 다 보내기보다, 엣지에서 inference 수행 후 결과만 보내는 편이 효율적

- 향후 6G 대비 → 6G에서는 네트워크 자체가 AI-native로 설계되므로, DU/기지국에서 AI 모델 학습/추론이 상시 수행될

가능성 큼

요약

- 모든 기지국에 AI칩을 넣는 것은 아님 → 중앙/엣지/기지국 중 역할에 맞춰 배치

- vRAN, Open RAN DU/CU, MEC 서버 등 서버형 기지국에는 GPU, NPU, FPGA 같은 AI 가속기가 들어갈 가능성이 매우 높음

- 초기에는 중앙/엣지 inference 중심 → 시간이 지나면 기지국 레벨 inference까지 확장될 전망

---------------------

“기지국/DU·CU·엣지(MEC)”에 실제로 어떤 AI 칩·가속기가 들어가고, 통신사들이 어떤 프로젝트를 진행 중인지 핵심만 콕 집어 정리해드릴게요.

1) 칩·가속기 측면 (무엇이 들어가나)

- GPU 기반 vRAN/AI-RAN

- NVIDIA Aerial: 5G L1/L2까지 GPU로 가속하는 vDU 플랫폼. 상용·연구망에 배치 사례가 있고, 동일 GPU 인프라에서 RAN과 AI 워크로드를 동시 처리하는 AI-RAN 모델을 제시. (NVIDIA Developer)

- ARC-Compact: 셀 사이트(기지국) 제약(전력/공간/폼팩터)에 맞춘 저전력 AI-RAN용 GPU 솔루션(Arm 생태계 기반). 엣지 분산 배치를 겨냥. (NVIDIA Developer)

- NVIDIA Aerial: 5G L1/L2까지 GPU로 가속하는 vDU 플랫폼. 상용·연구망에 배치 사례가 있고, 동일 GPU 인프라에서 RAN과 AI 워크로드를 동시 처리하는 AI-RAN 모델을 제시. (NVIDIA Developer)

- x86 + AI 명령어/가속

- 인텔 계열 vRAN 스택(FlexRAN 등)과 결합 시, 서버형 DU/CU에서 RAN + 경량 AI 추론을 함께 돌리는 구성이 확산. (일반 개념 설명 — 벤더 문서 다수)

- 네트워크 벤더 통합형

- 삼성 vRAN + NVIDIA 가속: 상호 통합으로 AI-RAN 딜리버리를 표방(상용 vRAN·Open RAN 레퍼런스 기반). (Samsung Newsroom, Samsung)

- 에릭슨 AI 앱 스위트: RAN 단 에너지 최적화 등 AI/ML 앱을 rApp/xApp 형태로 올려서 라디오 유닛 전력 소비를 동적으로 제어. (ericsson.com)

- 삼성 vRAN + NVIDIA 가속: 상호 통합으로 AI-RAN 딜리버리를 표방(상용 vRAN·Open RAN 레퍼런스 기반). (Samsung Newsroom, Samsung)

요약: 초기엔 vRAN/서버형 DU에 GPU(NVIDIA 등) + x86 조합이 빠르게 확산되고 있고, 셀 사이트에 바로 들어가는 초소형/저전력 GPU(ARC-Compact 같은 형태)도 등장했습니다. 장기적으로는 NPU/ASIC, FPGA 등 다양한 가속기가 혼재할 가능성이 큽니다. (NVIDIA Developer)

2) 통신사·벤더 프로젝트 (어디서 어떻게 쓰나)

- 소프트뱅크(SoftBank)

- 보다폰(Vodafone) × 에릭슨(Ericsson)

- 런던 일부 5G 사이트에서 라디오 유닛 일일 전력 최대 33% 절감(사용자 경험 저하 없이) — AI 기반 에너지 최적화 실증. (ericsson.com)

- 삼성 네트웍스

- 노키아(Nokia) × AT&T

- 음성코어/5G 네트워크 자동화(=AI/ML 내장) 다년 계약. 대형 운영망에 AI 기반 자동화가 본격 스며드는 흐름. (Reuters)

- AI-RAN Alliance 생태계

- 2024년 출범 후 **회원 100+**로 급성장(보다폰 합류 등). RAN에서의 AI 상용화 검증과 벤치마킹/테스트랩 확충 중. (Computer Weekly, AI-RAN Alliance)

- 엔비디아 × 6G 연구 생태계

- AI 활용 6G 시뮬레이션/테스트 클라우드 플랫폼 발표 — 노키아/삼성/소프트뱅크/노스이스턴대 등이 초기 사용자. (RAN+AI 공진화 로드맵과 맞물림) (Reuters)

결론 (간단 요약)

- “모든 기지국에 AI칩”은 아니지만, vRAN/DU·CU·엣지 서버에는 GPU 중심의 AI 가속기 탑재가 빠르게 늘고 있습니다. 초기 효과는 에너지 절감/자동화/품질 최적화, 중장기적으로는 동일 인프라에서 RAN+AI 서비스 동시 제공(예: 영상 분석, 개인화 서비스)입니다. (NVIDIA Developer, ericsson.com)

--------------------

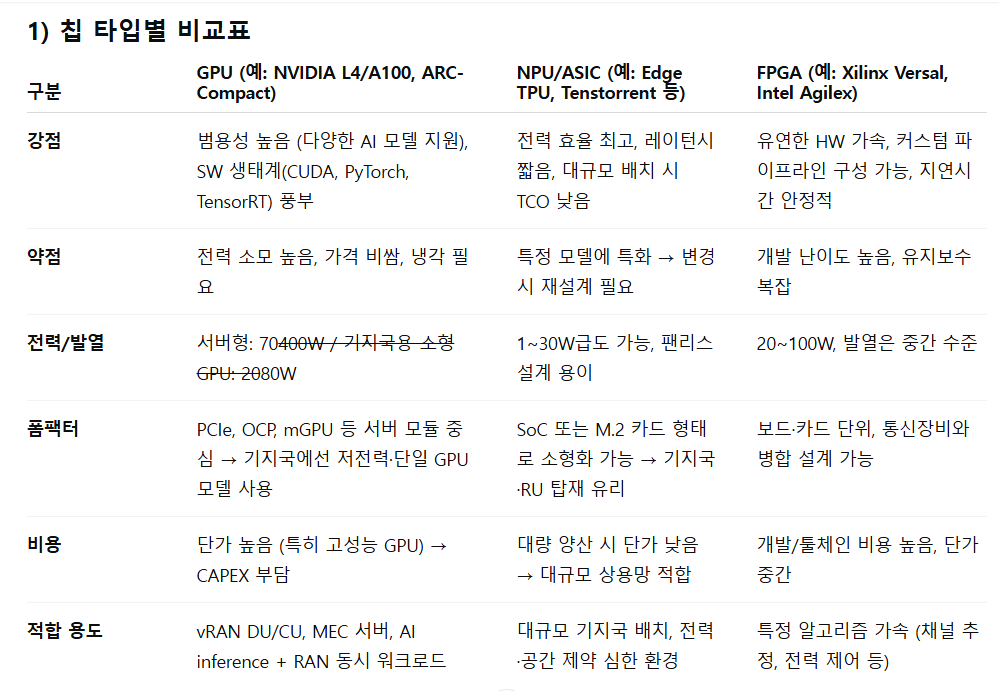

그럼 이번엔 AI-RAN 기지국/엣지 서버에 들어가는 칩을 기준으로

GPU vs NPU/ASIC vs FPGA 장단점을 표로 정리하고,

엣지 환경(기지국·MEC)에 맞춘 전력·발열·폼팩터·비용 시나리오도 같이 보여드릴게요.

3) 결론

- 초기 상용망 → GPU 기반 vRAN + MEC가 중심 (범용성·SW 생태계 때문)

- 대규모 배치/전력 제한 기지국 → NPU/ASIC 채택 가능성 높음 (TCO 절감)

- 특수·커스텀 네트워크 → FPGA로 맞춤 최적화

즉, AI-RAN Alliance가 제시하는 “AI-on-RAN/AI-and-RAN” 모델이 확산되면,

도심·핵심 노드엔 GPU, 전국망 기지국엔 NPU/ASIC, 특수목적엔 FPGA라는

혼합형 생태계가 될 가능성이 큽니다.

------------------------

"주 7일 근무 863억원" 한국에선 상상도 못할 보상, 싱글벙글 엔비디아 역대급 신기술